本文首发于 2026年4月9日,北京

一、开篇引入

你是否遇到过这样的情况:在智能楼宇项目中调用某个AI能力时,能实现功能,但一旦被问到“LLM如何理解‘把会议室温度调低一点’这句话”“知识图谱在楼宇语义理解中到底扮演什么角色”,就答不上来?这恰恰是当前智能建筑领域一个高频必学知识点背后的典型困境:很多开发者只掌握了“怎么调接口”,却不懂“为什么这么设计” ,面试时在“大语言模型(LLM,Large Language Model)”“检索增强生成(RAG,Retrieval-Augmented Generation)”“知识图谱”等概念间反复绕圈。

楼宇AI助手,正是近年来AI技术与建筑自动化深度融合的产物。它通过融合大语言模型、知识图谱和多智能体技术,将传统“执行指令”的楼宇自控系统升级为能“听懂、看懂、做懂”建筑运行的智能体-18。本文将系统讲解楼宇AI助手的技术全景——从传统楼宇自控的痛点出发,拆解LLM、RAG、知识图谱、多智能体等核心概念及其内在关系,提供可运行的极简代码示例,点明底层原理,最后附上高频面试题与标准答案。全文旨在帮你建立从问题到原理、从概念到代码的完整知识链路。

本文是“AI+建筑技术栈解析”系列第一篇。后续将深入探讨多智能体协同、边缘AI部署、数字孪生与AI融合等进阶话题,欢迎持续关注。

二、痛点切入:为什么需要楼宇AI助手

2.1 传统楼宇自控的典型实现方式

在传统楼宇中,环境调控和能源管理依赖一套“规则驱动”的控制系统。以下是典型的伪代码实现:

传统楼宇自控:基于规则的响应式控制 class TraditionalBAC: def __init__(self): self.rules = { "空调": {"温度>26℃": "开启制冷", "温度<18℃": "开启制热"}, "照明": {"光强<300lux且有人": "开灯", "无人": "关灯"}, "新风": {"CO₂>1000ppm": "启动新风"} } def handle_sensor_data(self, sensor_values): """被动响应式控制:收到数据→匹配规则→执行动作""" actions = [] if sensor_values["温度"] > 26: actions.append("空调制冷开启") if sensor_values["光强"] < 300 and sensor_values["是否有人"]: actions.append("照明开启") if sensor_values["CO₂"] > 1000: actions.append("新风启动") return actions 执行一系列离散动作,各子系统独立运行

2.2 传统方案的四大痛点

这种“规则驱动、被动响应”的传统架构存在系统性缺陷:

数据割裂:空调、照明、电梯等子系统各自为政,数据无法共享。据行业统计,传统模式下因系统独立运行导致的空调能耗浪费超过30%-45。

响应迟钝:传感器数据需上传至云端处理后再下发指令,调控延迟长达数分钟。例如会议室温度骤升时,传统系统需5分钟才能完成调节-45。

能耗黑洞:设备长期满负荷运行,缺乏动态节能策略,依靠人工定时巡检与手动调控,操作繁琐且效率低下-。

语义鸿沟:用户说“这里有点闷”时,传统系统无法理解意图——它不认识“闷”这个词,更不知道“闷”可能意味着需要降低CO₂浓度或调低温度。

2.3 新技术出现的必要性

正是这些痛点催生了楼宇AI助手的诞生。与传统方案相比,楼宇AI助手具备三大革新:语义理解——能解析自然语言中的隐式意图;智能决策——不依赖预设规则,而是基于数据驱动进行推理与优化;自主执行——可完成“感知→理解→诊断→决策→优化”的闭环-18。

据行业数据,新一代AI驱动的楼宇管理系统已在实测中实现整体能耗超过20%的优化提升-44,暖通系统节能率达24.48%,综合节能达28.4%-35。

三、核心概念讲解:大语言模型(LLM)

3.1 标准定义

大语言模型(LLM,Large Language Model) 是指基于Transformer架构、在海量文本数据上预训练得到的、参数规模达到数十亿乃至数千亿的深度神经网络模型,具备强大的自然语言理解与生成能力。

3.2 关键词拆解

“大”:既指参数量大(从几亿到几千亿不等),也指训练数据量大(TB级别文本),还指计算资源需求大。

“语言模型” :本质是一个概率模型,通过计算词序列的出现概率来“预测”下一个词应该是什么。

“预训练” :先在大规模通用数据上学习语言的基本规律,再在特定领域数据上微调,实现“通识教育+专业深造”的效果。

3.3 生活化类比

把LLM想象成一个读了上万本书的学霸:

他读过海量书籍(预训练),掌握了语法、逻辑和常识。

你问“如何让会议室更凉爽”,他不会机械地背诵空调说明书,而是结合上下文理解你的真实意图,给出“可以调低空调设定温度、打开新风系统或拉上遮阳帘”等综合建议。

如果在楼宇运维领域再给他看100本专业手册(微调),他就能成为懂建筑、懂暖通、懂能效的“专家”。

3.4 在楼宇AI助手中的作用与价值

LLM是楼宇AI助手的 “大脑” ,承担三大核心任务:

自然语言理解(NLU,Natural Language Understanding) :将用户的语音或文字指令转化为机器可理解的语义表示。

意图解析与任务拆解:理解用户真正想要什么,并将复杂需求拆解为可执行的子任务。

对话管理与答案生成:在多轮对话中保持上下文连贯性,生成用户可读的回复。

例如,当运维人员说“四楼西侧空调好像不太对劲”,LLM能识别出意图是“故障诊断”,提取关键信息“四楼西侧”“空调”,并自动关联知识图谱中的历史故障记录和运维手册。

四、关联概念讲解:检索增强生成(RAG)与知识图谱

4.1 检索增强生成(RAG)

RAG(Retrieval-Augmented Generation,检索增强生成) 是一种将信息检索与LLM生成相结合的架构:先根据用户查询从知识库中检索相关文档,再将检索结果作为上下文输入LLM,从而生成更准确、更具时效性的答案。

楼宇场景中的RAG运作机制:

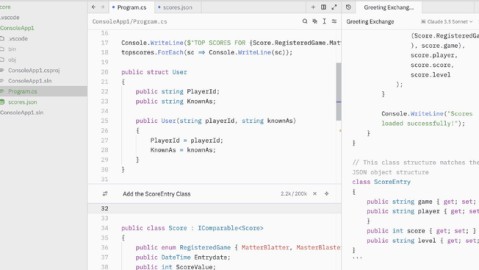

RAG架构伪代码示例 class RAGForBuilding: def __init__(self, llm, vector_db, building_knowledge_base): self.llm = llm 大语言模型 self.vector_db = vector_db 向量数据库,存储知识库的向量索引 self.kb = building_knowledge_base 楼宇知识库(运维手册、设备文档等) def answer_query(self, user_question): Step 1: 检索——将用户问题向量化,在知识库中检索最相关的文档片段 query_vector = embed(user_question) retrieved_docs = self.vector_db.similarity_search(query_vector, top_k=5) Step 2: 增强——将检索到的文档作为上下文,与用户问题拼接成增强提示 context = "\n".join(retrieved_docs) enhanced_prompt = f"基于以下楼宇运维知识:\n{context}\n\n回答问题:{user_question}" Step 3: 生成——LLM基于增强后的提示生成最终答案 answer = self.llm.generate(enhanced_prompt) return answer

4.2 知识图谱(KG,Knowledge Graph)

知识图谱是一种用图结构(节点表示实体,边表示关系)来建模知识的语义网络。在楼宇场景中,它描述设备、空间、系统之间的结构化关系。

楼宇知识图谱的典型内容:

实体节点:空调机组、楼层、房间、传感器、运维人员

关系边:空调A“位于”3层、空调A“控制”房间301、温度传感器S1“监测”空调A

属性:设备型号、额定功率、历史故障记录

4.3 三者的关系与区别

这是一个三足鼎立、相互支撑的关系:

| 概念 | 核心作用 | 类比 | 局限 |

|---|---|---|---|

| LLM | 通用理解与生成 | 学霸的大脑 | 对专业领域知识记忆不准(“幻觉”问题) |

| RAG | 实时检索外部知识,提升准确性 | 学霸查阅专业手册 | 检索质量影响答案准确性 |

| 知识图谱 | 提供结构化、可推理的领域知识 | 学霸脑中梳理好的知识网络 | 构建成本高,需要领域专家参与 |

一句话总结:LLM负责“懂人话”,RAG负责“查资料”,知识图谱负责“理逻辑” 。三者有机结合,才能让楼宇AI助手既理解自然语言,又给出准确可靠的专业答案。

前沿研究表明,采用知识图谱增强的RAG架构,在楼宇语义问答任务中已实现上下文召回率达90%、答案准确率达88%的显著效果-10。

五、概念关系与区别总结

5.1 逻辑关系梳理

楼宇AI助手的完整技术栈呈现分层递进结构:

用户自然语言输入 ↓ ┌──────────────────────────────────────┐ │ LLM(自然语言理解与意图解析) │ ← “听得懂人话” └──────────────────────────────────────┘ ↓ ┌──────────────────────────────────────┐ │ 多智能体协同(任务规划与执行编排) │ ← “想得明白怎么干” └──────────────────────────────────────┘ ↓ ┌──────────────────────────────────────┐ │ RAG + 知识图谱(检索与推理) │ ← “知识准确可靠” └──────────────────────────────────────┘ ↓ 楼宇自控系统执行指令

5.2 一句话记忆口诀

LLM是“大脑”,RAG是“书架”,知识图谱是“思维导图”,多智能体是“行动小队”——四者协同,让AI真正“懂建筑、会思考、能执行”。

六、代码/流程示例演示

6.1 极简楼宇AI助手的RAG实现

以下代码展示了一个简化版的楼宇AI助手核心逻辑:

import json from typing import List, Dict import numpy as np 模拟:楼宇知识库(真实场景中会使用向量数据库和真实LLM) building_kb = { "AHU-101": {"位置": "3层西侧", "型号": "特灵冷暖机组", "额定功率": "45kW", "最近故障": "2026-03-15 过滤网堵塞"}, "AHU-102": {"位置": "5层东侧", "型号": "开利变频机组", "额定功率": "60kW", "最近故障": "无"}, "室温标准": {"夏季": "24-26℃", "冬季": "20-22℃", "CO₂上限": "1000ppm"} } 模拟:轻量级文本向量化(实际应使用Embedding模型) def simple_embed(text: str) -> np.ndarray: """极简模拟:用字符Unicode均值生成向量,仅演示流程""" return np.array([ord(c) for c in text[:100]] + [0] (100 - len(text[:100]))) def similarity_search(query: str, kb: Dict, top_k: int = 2) -> List[str]: """基于关键词的简单检索(实际应用中使用向量相似度)""" Step 1: 关键词提取(极简化,真实场景用NER/NLP) keywords = [] if "空调" in query or "AHU" in query: keywords = ["AHU", "空调", "机组"] if "温度" in query or "室温" in query: keywords.append("温度") Step 2: 检索知识库 results = [] for key, value in kb.items(): value_str = json.dumps(value, ensure_ascii=False) for kw in keywords: if kw in key or kw in value_str: results.append(f"{key}: {json.dumps(value, ensure_ascii=False)}") break return results[:top_k] def rag_answer(user_query: str) -> str: """ 楼宇AI助手的RAG问答核心流程: 1. 检索:从知识库中召回相关信息 2. 增强:将检索结果构建为上下文提示 3. 生成:基于上下文生成答案(此处用模板模拟LLM输出) """ print(f"📝 用户提问: {user_query}") Step 1: 检索 retrieved = similarity_search(user_query, building_kb, top_k=2) print(f"📚 检索到的知识: {retrieved}") Step 2: 增强——构建上下文提示 context = "\n".join(retrieved) enhanced_prompt = f"""【楼宇运维知识库】 {context} 【用户问题】 {user_query} 【回答要求】 请基于上述知识库内容回答用户问题,如果知识库中缺少相关信息,请明确告知。 """ Step 3: 生成(模拟LLM输出,真实场景调用LLM API) if "AHU-101" in context and "故障" in user_query: return "🔧 根据知识库记录,AHU-101(3层西侧空调机组)于2026年3月15日报过滤网堵塞故障,建议现场检查并清理过滤网。" elif "温度" in user_query or "室温" in user_query: return "🌡️ 楼宇室温标准:夏季24-26℃,冬季20-22℃。当前室内温度请查看具体区域传感器读数。" elif "空调" in user_query and "位置" in user_query: return "📍 AHU-101位于3层西侧,AHU-102位于5层东侧。" else: return "💡 我暂时没有找到相关信息。您可以提供更具体的问题,如'AHU-101最近有什么故障'或'夏季室温标准是多少'。" 运行示例 if __name__ == "__main__": print("=" 50) print("🏢 楼宇AI助手 RAG问答演示") print("=" 50) 示例1:故障查询 print(rag_answer("AHU-101最近有什么故障?")) print() 示例2:标准查询 print(rag_answer("夏季的室温标准是多少?")) print() 示例3:位置查询 print(rag_answer("3层的空调机组在哪里?"))

6.2 执行流程说明

当用户输入“AHU-101最近有什么故障?”时:

意图解析:LLM识别出意图类型为“设备故障查询”,实体为“AHU-101”。

检索增强:系统在知识库/向量数据库中检索与“AHU-101”和“故障”相关的文档片段。

上下文融合:将检索到的AHU-101信息(位置、型号、最近故障记录)与用户问题拼接。

生成回答:LLM基于上下文生成包含故障详情和处置建议的精准回答。

与前面提到的传统规则系统相比,RAG架构的优势在于:无需为每一个可能的查询预定义规则,LLM能基于检索到的动态知识,灵活应对各种自然语言表述。

七、底层原理/技术支撑点

7.1 LLM的核心——Transformer与自注意力机制

LLM以Transformer架构为基石,其核心是 “自注意力机制(Self-Attention)” 。通俗来说,自注意力让模型在处理一个词时,能够“关注”到句子中所有其他词,并判断哪些词与当前词的关系更紧密。这使得LLM能够捕捉长距离语义依赖——例如,在“昨天我在三楼会议室开的空调,今天它好像不制冷了”这句话中,“它”能正确关联到“空调”。

7.2 RAG的核心——向量检索与嵌入

RAG依赖向量数据库(如Milvus、Pinecone、Qdrant)和嵌入模型(Embedding Model) 。文本被转化为高维向量后,相似度的本质是在向量空间中寻找距离最近的向量。楼宇知识库中的每个文档(运维手册片段、设备参数表等)预先被向量化存储,查询时只需计算用户问题向量与库中向量的相似度,即可快速召回最相关的内容。

7.3 知识图谱的核心——图数据库与语义推理

知识图谱通常基于图数据库(如Neo4j、JanusGraph)或RDF三元组存储(如Brick Schema——楼宇领域专用的语义数据模型),支持SPARQL等图查询语言-4。语义推理能力使系统能够回答“所有位于3层的空调设备”这类跨实体、跨关系的复杂查询,这正是传统规则系统难以实现的。

7.4 多智能体的核心——任务编排与工具调用

近年来,多智能体(Multi-Agent)架构成为楼宇AI助手的重要演进方向。多个AI Agent协同工作,分别承担感知、规划、执行、评估等角色,形成类似PDCA(Plan-Do-Check-Act)的闭环优化机制-10。例如,LoopRAG框架在建筑语义问答任务中通过多智能体协同,显著提升了多轮对话和动态推理能力-10。

八、高频面试题与参考答案

面试题1:楼宇AI助手与传统楼宇自控系统的核心区别是什么?

参考答案(分点作答,便于记忆):

交互方式:传统系统依赖GUI界面和预设规则,用户需学习专业操作流程;楼宇AI助手支持自然语言交互,用户可用语音/文字直接表达意图。

决策机制:传统系统是被动的、规则驱动的反馈控制;楼宇AI助手是主动的、数据驱动的预测优化控制-44。

知识获取:传统系统的知识固化在代码和配置中,难以扩展;楼宇AI助手通过RAG和知识图谱动态检索、持续学习。

系统边界:传统系统各子系统独立运行;楼宇AI助手实现跨系统协同优化(如空调、照明、新风联动)。

面试题2:在楼宇AI助手中,为什么RAG比单纯微调LLM更适合?

参考答案:

知识更新效率:楼宇运维知识(设备参数、标准规范)频繁变化。微调需要重新训练模型,周期长、成本高;RAG只需更新向量数据库,实时生效。

避免灾难性遗忘:微调可能导致模型遗忘预训练阶段学到的通用知识;RAG保持LLM通用能力不变,仅动态补充领域知识。

可追溯性:RAG可以返回检索到的原始文档作为依据,便于审计和故障排查;微调模型是“黑盒”,难以解释答案来源。

计算资源友好:对数十亿参数的LLM进行完整微调成本高昂;RAG以轻量级的检索+上下文注入完成知识增强,更适宜边缘部署。

面试题3:LLM存在“幻觉”问题,在楼宇管理这种高可靠性场景中如何应对?

参考答案:

RAG增强:强制LLM基于检索到的真实知识库回答,而非依赖模型内部记忆,从源头减少编造。

知识图谱约束:将LLM输出与知识图谱中的结构化事实进行一致性校验,过滤矛盾信息。

多智能体交叉验证:由多个专用Agent分别回答同一问题,对比结果一致性,不一致时触发人工复核。

可控生成:将LLM的输出空间限定在预定义的楼宇操作范围内,不给予自由发挥的空间。

人机协同机制:关键决策(如涉及安全的设备控制)必须经人工确认,AI仅提供建议不直接执行。

面试题4:知识图谱在楼宇AI助手中具体解决什么问题?

参考答案:

语义消歧:“温度升高”可能指空调设定温度、环境实测温度或设备运行温度,知识图谱通过实体关系区分不同含义。

跨设备推理:当用户说“三楼西侧空调不制冷”,知识图谱可推理出三楼西侧关联的AHU设备编号,并定位到具体传感器-4。

因果诊断:基于设备-空间-系统的关系网络,快速定位故障链(如“冷站效率下降→供水温度升高→末端空调制冷不足”)。

可解释性:回答“为什么空调不制冷”时,知识图谱可展示推理路径,让用户看到“因为X→所以Y→导致Z”的逻辑链条。

面试题5:什么是Brick Schema?它在楼宇AI助手中起什么作用?

参考答案:

Brick Schema 是楼宇领域专用的语义数据模型,基于RDF(Resource Description Framework,资源描述框架)定义了一套标准化的本体(Ontology),用于描述楼宇中的设备、空间、系统和观测数据之间的关系-4。

作用:为楼宇知识图谱提供标准化的“骨架”。它确保不同来源的楼宇数据能够以统一的语义格式存储和查询,让LLM和RAG系统能够跨设备、跨协议地理解楼宇数据结构,显著降低楼宇AI助手在不同建筑之间的适配成本。NIST等机构也在推动类似标准化工作,旨在构建机器可读的楼宇系统语义模型,为AI驱动的分析和控制奠定基础-。

九、结尾总结

9.1 核心知识点回顾

| 技术组件 | 核心职责 | 面试关键词 |

|---|---|---|

| LLM | 自然语言理解与生成 | Transformer、自注意力、预训练、微调 |

| RAG | 动态知识检索与增强 | 向量检索、嵌入、上下文注入、降低幻觉 |

| 知识图谱 | 结构化知识与推理 | 图数据库、Brick Schema、SPARQL、语义推理 |

| 多智能体 | 任务编排与协同执行 | PDCA闭环、Agent协同、工具调用 |

9.2 重点与易错点提醒

易混淆点:不要将RAG等同于简单的“关键词”。RAG的核心在于用向量相似度实现语义级检索,且检索结果作为上下文输入LLM而非直接作为答案。

易错点:LLM是“大脑”,但不应让它直接控制物理设备。生产环境中必须设计安全隔离层——LLM生成意图和参数,由安全控制器校验后再下发执行。

面试加分点:能讲清楚Brick Schema如何解决楼宇数据异构问题,以及边缘部署LLM对隐私保护的价值(如本地化部署消除数据上云顾虑)-2。

9.3 进阶预告

本文搭建了楼宇AI助手的技术全景。下一篇将深入探讨多智能体协同架构,包括:

Plan-Do-Check-Act闭环优化在建筑运维中的应用

多个AI Agent如何分工协作(感知Agent、诊断Agent、决策Agent、执行Agent)

基于MCP(Model Context Protocol)的标准化工具调用-18

欢迎在评论区留言你最想了解的进阶话题,我们下期见!

参考资料

[1] 品茗科技. 品茗科技亮相2026年工程建设行业科技工作会议[EB/OL]. 2026-03-31.-1

[2] Canberra IP. AI-Powered Smart Building Management[EB/OL]. 2026-03-26.-2

[3] Devmane S, Rana O, Perera C. OntoSage: Intelligent human-building smartbot for semantic smart building question answering[J]. World Wide Web, 2026, 29: 17.-4

[4] LoopRAG: A Closed-Loop Multi-Agent RAG Framework for Interactive Semantic Question Answering in Smart Buildings[J]. Buildings, 2026, 16(1): 196.-10

[5] 施耐德电气. EcoStruxure™ Building GPT楼宇智能运维专家[EB/OL]. 2025.-14

[6] 达实智能. 实时数据接入AI大模型,达实智能引领智慧园区进入大模型时代[EB/OL]. 2025-03-19.-23

[7] 希嘉科技. 希嘉科技亮相2025楼宇经济大会[EB/OL]. 2025-08-05.-35

[8] 台达-中达电通. 双碳目标与AI浪潮叠加下,楼宇自控如何重塑价值[EB/OL]. 2025-12-19.-44

[9] 有人物联网. 边缘计算网关在智能楼宇多区域环境感知与节能协同控制[EB/OL]. 2025-05-06.-45

[10] 中碳能源. 深企发布百亿Tokens级“AI+能源”智能体[EB/OL]. 2026-04-01.-64

[11] Nodeledge. Nodeledge adds AI to smart building platform[EB/OL]. 2026-04-07.-66

[12] 北京CBD. 北京CBD开启全域“无感节能”实验[EB/OL]. 2026-03-23.-68