北京时间 2026年4月10日 | 阅读时长约 10 分钟

一、开篇引入

在 AI 全面渗透操作系统的今天,Apple Intelligence(苹果 AI 助手) 已经成为 iOS、iPadOS 和 macOS 生态中不可或缺的核心能力。它是苹果在 2024 年 WWDC 上正式发布的个人化智能系统,深度整合于设备操作系统中,通过强大的生成式模型让苹果装置变得更聪明、更个人化-2。作为苹果 AI 助手免费为用户提供的能力,它覆盖了从写作辅助、智能摘要、图像处理到实时翻译等日常高频场景-6。

许多开发者和技术学习者面临的痛点是:每天都在用 Apple Intelligence,却不清楚它的三层架构是如何协同工作的;知道“本地优先、隐私至上”,却说不清 Private Cloud Compute 与传统云 AI 的本质区别;面试时被问到路由机制或底层原理时,往往只能回答表面皮毛。本文将从问题→概念→关系→示例→原理→考点的链路,系统梳理 Apple Intelligence 的核心技术体系,让读者不仅会用,更懂原理。

二、痛点切入:传统 AI 集成的局限

在 Apple Intelligence 出现之前,开发者在 iOS 应用中集成 AI 能力,通常面临以下困境:

// 传统方案:调用云端 API func summarizeText(_ text: String) async throws -> String { let url = URL(string: "https://api.cloudai.com/summarize")! var request = URLRequest(url: url) request.httpBody = try JSONEncoder().encode(["text": text]) let (data, _) = try await URLSession.shared.data(for: request) return try JSONDecoder().decode(SummaryResponse.self, from: data).summary }

这种方式的三个致命缺陷:

| 问题 | 说明 |

|---|---|

| 隐私风险 | 用户数据必须离开设备,传输到云端服务器,存在泄露风险 |

| 网络依赖 | 无网络环境或弱网下功能完全不可用 |

| 成本高昂 | API 调用按次计费,对开发者产生持续成本 |

苹果 AI 助手免费的设计初衷正是在于打破这一困局——将 AI 能力直接内置到操作系统层,让开发者无需支付云端 API 费用,用户也无需上传个人数据就能享受到智能化功能。

三、核心概念讲解:Apple Intelligence(苹果 AI 助手)

英文全称:Apple Intelligence

中文释义:苹果智能,是苹果公司为其生态系统打造的“个人化 AI 助手”系统

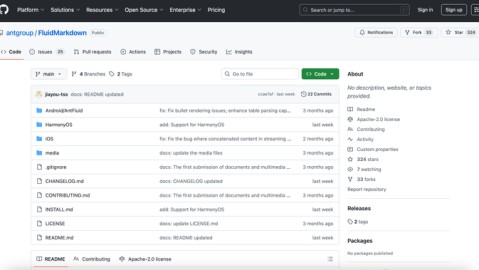

Apple Intelligence 的核心架构围绕三个层级展开-13:

能力足够

计算需求超出

能力仍不够

用户请求

本地端侧模型

30亿参数 LLM

设备本地处理

隐私保护, 零延迟

Private Cloud Compute

私有云计算

第三方模型调用

ChatGPT 等

返回结果

层级一:本地端侧模型(On-Device Model)

这是 Apple Intelligence 的第一道防线。一个约 30 亿参数的语言模型直接在设备上运行,利用 A17 Pro、A18 系列或 M 系列芯片中的 Neural Engine(神经网络引擎) 来处理任务-13。该模型基于 Transformer 架构,采用了 Grouped-Query Attention(分组查询注意力) 和 SwiGLU 激活函数等多种优化技术,有效提高了模型的运作效率和稳定性-。

生活化类比:本地端侧模型就像是你的“私人秘书”——他就在你身边,反应迅速,你的所有隐私信息只和他分享,不需要经过任何中间人。

层级二:私有云计算(Private Cloud Compute, PCC)

当本地模型的处理能力不足以应对复杂请求时,Apple Intelligence 会将任务转发至 PCC。这是苹果专门为云端 AI 隐私保护设计的突破性架构-12。

PCC 的核心设计目标包括:

无状态计算(Stateless Compute) :任务完成后数据即刻销毁

无特权访问(No Privileged Access) :包括苹果内部员工在内的任何人无法访问用户数据

可验证透明性(Verifiable Transparency) :安全研究人员可独立验证系统运行状态-

层级三:第三方模型调用

苹果还与 OpenAI 合作,将 ChatGPT 集成到平台中。用户在发送请求前需要明确同意,苹果会隐藏用户 IP 地址,OpenAI 不会存储这些请求-13。

四、关联概念讲解:Foundation Models 框架

英文全称:Foundation Models Framework

中文释义:基础模型框架,是苹果向第三方开发者开放 Apple Intelligence 能力的官方 SDK

Foundation Models 框架让开发者能够直接访问与 Apple Intelligence 同源的设备内置大型语言模型(On-Device LLM),为 App 带来智能体验-4。

它与 Apple Intelligence 的关系

| 维度 | Apple Intelligence | Foundation Models 框架 |

|---|---|---|

| 定位 | 系统级 AI 能力集合 | 开发者调用接口 |

| 使用者 | 苹果原生应用(Siri、Mail、Photos 等) | 第三方 App 开发者 |

| 运行环境 | 操作系统内置 | 通过 Swift API 调用 |

| 隐私模型 | 同设备处理 | 继承设备处理特性 |

简单来说:Apple Intelligence 是“AI 引擎”,Foundation Models 是“方向盘” ——前者提供能力,后者提供调用方式。

运行机制示例

App 通过 Foundation Models 框架向设备内置模型发起请求时,会经过两道安全过滤器的检查:

用户 App → 输入过滤器 → 本地 LLM → 输出过滤器 → 返回结果 ↑ ↑ 检测不安全输入 检测不安全输出

一旦检测到不安全内容,API 调用会在到达 LLM 之前或返回用户之前被阻断-20。

五、概念关系与区别总结

Apple Intelligence 是“思想”,Foundation Models 是“工具”;Apple Intelligence 定义“做什么”,Foundation Models 规定“怎么做”。

Apple Intelligence:操作系统层面的 AI 能力集合,包含端侧模型、PCC 和第三方集成三层架构

Foundation Models:面向开发者的编程接口,通过 Swift API 提供对端侧模型的访问能力

二者是“能力”与“接口”的关系,统一于“设备优先、隐私至上”的设计哲学之下。

六、代码/流程示例:Foundation Models 实战

以下是一个完整的 Swift 示例,展示如何通过 Foundation Models 框架调用苹果 AI 助手能力-29:

import FoundationModels struct AppleIntelligenceDemo { // 步骤1:检查设备可用性 func checkAvailability() -> Bool { return SystemLanguageModel.default.isAvailable } // 步骤2:获取不可用原因(便于精准引导用户) func getUnavailabilityReason() -> SystemLanguageModel.Availability { return SystemLanguageModel.default.availability } // 步骤3:核心生成函数 func generateResponse(for input: String) async throws -> String { // 关键:先检查可用性,否则会抛出异常 guard SystemLanguageModel.default.isAvailable else { return "当前设备不支持 Apple Intelligence" } // 创建会话 let session = LanguageModelSession() // 发送请求并等待响应 let response = try await session.respond(to: input) // 返回模型生成的内容 return response.content } }

代码执行流程解析:

导入框架:

import FoundationModels引入苹果 AI 助手能力可用性检查:

SystemLanguageModel.default.isAvailable判断当前设备(芯片型号+系统设置)是否支持创建会话:

LanguageModelSession()初始化与本地 LLM 的交互通道发送请求:

session.respond(to:)异步调用,输入经过输入过滤器后到达模型返回结果:模型输出经过输出过滤器校验后返回

关键要点:整个过程数据不离开设备,无需网络连接,对开发者完全免费-3-4。

七、底层原理/技术支撑

Apple Intelligence 的底层技术栈由三大支柱构成:

1. 硬件基础:Apple Silicon 神经引擎

本地端侧模型依赖 A17 Pro、A18 系列和 M 系列芯片中的 Neural Engine,这是一个专门为神经网络计算设计的硬件加速单元,能够在极低功耗下完成矩阵运算和推理任务-6。

2. 安全核心:Secure Enclave 与 Secure Boot

PCC 服务器集成了苹果自研的 Secure Enclave(安全隔区) 和 Secure Boot(安全启动) 技术,确保服务器启动时的代码完整性。服务器没有持久性存储,每次启动都会为文件系统生成随机加密密钥,重启后数据“算后即焚”-11-12。

3. 隐私技术:差分隐私与合成数据

苹果在模型训练阶段采用 Differential Privacy(差分隐私) 和 Synthetic Data(合成数据) 技术,确保用户真实数据永不离开设备。系统通过匿名比对本地的合成数据来优化模型响应-。

八、高频面试题与参考答案

Q1:请描述 Apple Intelligence 的三层架构及其设计目的

参考答案:

Apple Intelligence 采用三层架构。第一层是本地端侧模型,约 30 亿参数,在设备上利用神经引擎运行,处理日常任务的同时确保数据不出设备。第二层是 Private Cloud Compute,当本地能力不足时,将任务转发至专用服务器,采用无状态计算和可验证透明性设计,确保云端处理同样保护隐私。第三层是第三方模型调用,在用户明确同意下调用 ChatGPT 等外部模型。整体设计体现了“本地优先、云端按需、隐私贯穿始终”的核心原则。

踩分点:三层名称 + 各自作用 + 设计哲学(隐私优先)

Q2:Private Cloud Compute(PCC)与传统云 AI 服务的核心区别是什么?

参考答案:

PCC 与云 AI 的核心区别体现在五个维度:一是无状态计算,任务完成后数据即刻销毁,不保留日志;二是无特权访问,包括苹果内部员工在内的任何人都无法访问用户数据;三是可验证透明性,安全研究人员可独立审计系统运行状态;四是专用硬件,基于 Apple Silicon 和定制操作系统,攻击面极小;五是数据加密,端到端加密贯穿全链路。

踩分点:五个“无/可”关键词(无状态、无特权、可验证、专用硬件、端到端加密)

Q3:Foundation Models 框架对开发者的价值是什么?为什么免费?

参考答案:

Foundation Models 框架的价值在于让第三方开发者能够以零成本、零网络依赖的方式,在 App 中集成苹果同源的 AI 能力。开发者通过 Swift API 直接调用设备本地 LLM,无需搭建后端、无需支付 API 费用、无需处理隐私合规。苹果选择免费,一方面是其“AI 作为操作系统基础能力”战略的延伸——与 iOS SDK 免费开放逻辑一致;另一方面,AI 能力能够提升整个生态的应用体验,推动硬件销售,属于间接商业变现模式。

踩分点:免费原因(生态战略 + 硬件驱动)+ 三大优势(零成本、零网络、零合规负担)

Q4:本地端侧 LLM 如何保证输入输出的安全性?

参考答案:

Apple Intelligence 在本地 LLM 调用路径上设置了双重过滤机制:输入过滤器检测用户发送给 API 的数据,若包含不安全内容(如恶意指令、敏感词),则直接阻断 API 调用,请求不会到达模型;输出过滤器检测模型返回的响应,若生成不安全内容,API 调用失败,响应不会返回给用户。两个过滤器运行在同一个原子 API 层中,确保安全性检测无漏洞。

踩分点:输入过滤 + 输出过滤 + 原子 API 层

Q5:Apple Intelligence 与 Siri 是什么关系?

参考答案:

Apple Intelligence 是苹果的全平台 AI 能力系统,Siri 是其中一个前端交互入口。Apple Intelligence 为 Siri 提供了底层生成式模型能力,使 Siri 从传统的基于规则的问答系统升级为具备对话理解、上下文感知和生成能力的智能助手。同时,Apple Intelligence 的能力也通过写作工具、相册等其他系统组件直接面向用户,不局限于 Siri 一个入口。

踩分点:Siri 是入口 vs Apple Intelligence 是能力层

九、结尾总结

本文围绕 Apple Intelligence 这一苹果 AI 助手免费能力的核心技术体系,从三个层面进行了完整梳理:

概念认知:Apple Intelligence 是苹果的系统级 AI 能力集合,包含本地端侧模型(30亿参数)、Private Cloud Compute(PCC)和第三方模型调用三层架构

开发实战:Foundation Models 框架是面向开发者的调用接口,通过

SystemLanguageModel.default.isAvailable和LanguageModelSession().respond(to:)即可在 App 中免费集成 AI 能力底层支撑:Apple Silicon 神经引擎提供硬件加速,Secure Enclave/Secure Boot 保障安全,差分隐私与合成数据护航训练数据

关键易错点提醒:Apple Intelligence ≠ Siri;Foundation Models ≠ 云端 API;PCC ≠ 传统私有云。

🔜 下一篇预告:Apple Intelligence 提示词注入攻击(Prompt Injection)深度剖析——如何突破系统级安全防护?