从“手动修图”到“对话驱动”,AI图片小助手正在重塑图像生产范式

在2026年的AI技术版图中,AI图片小助手已成为开发者必学的核心技术方向之一。从Qwen-Image-2.0的生成编辑一体化,到像素蛋糕发布的行业首个专业级修图智能体“像素助手”,再到ComfyUI的节点式工作流成为创意生产的标准化引擎,AI图片助手的应用场景正在从“工具”进化为“拍档”-5。

许多学习者在接触这一领域时普遍面临同样的困境:会用AI绘图工具生成图片,却不理解背后生成编辑一体化的技术原理;听说过ComfyUI的节点式工作流,却混淆了“工作流”与“数据流”的本质区别;面试中被问到AI图像智能体的底层机制,往往只能答出表面皮毛。这些问题背后的根本原因在于:缺乏对AI图片助手完整技术链路的系统认知。

本文将围绕AI图片助手的技术栈,从行业痛点切入,逐步拆解ComfyUI节点式工作流、Stable Diffusion核心组件、以及底层依赖的扩散模型原理,最后给出高频面试题与标准答案,帮助读者建立从“会用”到“懂原理”的完整知识链路。

一、痛点切入:传统图像编辑的四大困境

在AI图片助手出现之前,传统的图像编辑与生成流程存在诸多局限。以人像修图为例,专业设计师需手动调整肤色、光影、五官比例等20余项参数,耗时30分钟以上;普通用户则面临参数理解门槛高、操作路径不清晰、效果评估主观性强三大困境-7。

而在图像生成领域,传统的Stable Diffusion使用方式也存在明显短板:用户通过UI界面输入提示词、调整参数、点击生成,整个过程是一个“黑盒”——开发者无法精细控制生成流程的中间环节,无法实现多模型切换、无法串联多个处理步骤。这种“一刀切”的方式在商业场景中暴露了以下问题:

耦合度高:文本编码、潜空间去噪、图像解码全部捆绑在单一流程中,无法拆解替换;

扩展性差:接入ControlNet姿态控制、IP-Adapter风格迁移等高级功能需要复杂的配置和调试;

调试困难:生成效果不理想时,无法定位问题是出在文本理解环节还是去噪环节;

复用率低:每个项目都需要重新搭建生成环境,优秀的工作流无法沉淀复用。

这些痛点的共同指向是:缺乏一个可配置、可复用、可调试的图像生成执行引擎。这正是ComfyUI诞生的核心动因——将复杂图像生成流程解耦为可连接的独立功能单元,让开发者像搭积木一样自由构建AI图片处理流水线。

二、核心概念讲解:ComfyUI与节点式工作流

ComfyUI(全称无缩写,直接以产品名使用)是一个基于节点式工作流的AI图像生成可视化执行引擎,它将Stable Diffusion等模型的复杂生成过程解耦为一个个可连接、可复用的功能模块(节点),让用户通过可视化界面搭建生成流水线,实现从文本到图像/视频的全流程精细控制-。

核心认知:工作流 = 数据流

所谓“流”,本质上是数据在节点之间流动的过程。一个典型的ComfyUI工作流可以表示为:节点A → 节点B → 节点C → 节点D,数据从A节点输出,经过B、C节点的处理,最终由D节点输出结果-21。

生活化类比:把ComfyUI比作一座自来水厂——

节点 = 处理站(沉淀池、消毒池、过滤池),每个站完成特定的水处理任务;

连线 = 管道,决定水流的方向和路径;

数据 = 流水,是被加工的对象;

输出 = 水龙头流出的干净饮用水。

ComfyUI中流动的核心数据类型:

| 数据类型 | 说明 |

|---|---|

| MODEL | UNet模型权重,是扩散模型的“大脑” |

| CLIP | 文本编码器,将文字转化为向量 |

| VAE | 图像编解码器,负责图像与潜空间的转换 |

| CONDITIONING | 条件向量,携带文本/图像的控制信息 |

| LATENT | 潜空间数据,图像在AI“思考”环节的压缩形态 |

| IMAGE | 标准图像数据 |

| MASK | 蒙版数据,用于指定编辑区域 |

ComfyUI的三个核心特点:

单向流动:数据从输出端流向输入端,保证流程方向明确;

类型匹配:连线两端的数据类型必须匹配,否则工作流无法执行;

可分支:一个输出端可以连接多个输入端,支持复杂流程的并行处理。

ComfyUI的价值在于:它将AI图片助手的执行逻辑从“黑盒”变为“白盒”,让开发者能够看到并干预每一个中间步骤,实现真正的可调试、可复用的图像生成流水线-21。

三、关联概念讲解:Stable Diffusion核心组件

要理解ComfyUI的工作机制,必须掌握其底层依赖的核心技术——Stable Diffusion的四大组件。

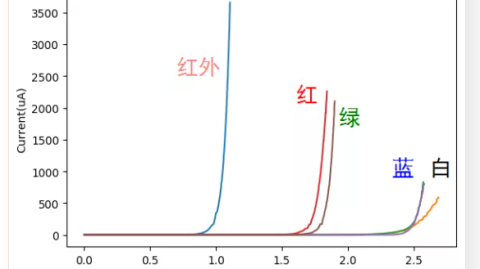

VAE(变分自编码器,Variational Autoencoder) :包含编码器和解码器两个部分。编码器将高清图像压缩到低维潜空间,解码器将潜空间数据还原为高清图像。一个典型的压缩:512×512×3像素 → 64×64×4潜空间,计算量降低约100倍,让消费级GPU即可运行扩散模型-。

CLIP(对比语言-图像预训练,Contrastive Language-Image Pre-training) :由OpenAI提出的多模态模型,能够将文字和图像都转换为向量表示,相似内容的向量在空间中彼此接近,建立起文字与图像之间的“语义桥梁”-21。

Token(词元) :文本处理的最小单元。例如“一只可爱的猫”被拆分为[一只]、[可爱]、[的]、[猫]四个Token。CLIP接收Token序列,将其转化为向量表示-21。

UNet:扩散模型的核心神经网络,负责预测噪声。它的结构特点是编码器压缩信息、解码器还原信息、跳跃连接保留细节。在大模型Checkpoint文件中,UNet部分通常占据80%-90%的体积-21。

四、概念关系与区别总结

理清AI图片助手中各个技术概念的逻辑关系,是理解整个技术栈的关键。这里用一句话帮助记忆:

ComfyUI是“执行引擎”(搭积木的平台),节点是“功能单元”(每块积木),Stable Diffusion是“底层模型”(积木内部的核心能力),工作流是“连接方案”(积木的拼搭方式)。

通过下表可以更清晰地对比各概念的本质差异:

| 概念 | 角色定位 | 类比 | 相互关系 |

|---|---|---|---|

| ComfyUI | 执行引擎/编排平台 | 搭积木的工作台 | 提供节点运行环境 |

| 节点 | 功能单元 | 每一块积木 | 在ComfyUI中运行 |

| Stable Diffusion | 底层模型 | 积木内部的机械结构 | 节点的核心能力来源 |

| 工作流 | 连接方案 | 积木的拼搭图纸 | 定义节点间的数据流向 |

简单来说:Stable Diffusion提供了“能做AI绘图”的能力,ComfyUI提供了“如何组织AI绘图流程”的编排框架,而节点是这两者之间的桥梁——每个节点调用Stable Diffusion的某个子能力(如CLIP文本编码、VAE解码、UNet去噪),工作流则决定了节点之间的数据传递顺序。

五、代码示例:从“手动修图”到AI图片助手

下面通过一个对比示例,直观展示AI图片助手如何替代传统的手动修图流程。

传统手动修图方式(伪代码示意):

传统方式:手动调整多个参数 def manual_image_editing(image_path, target_style): img = load_image(image_path) 步骤1:手动调整亮度 brightness = manual_adjust(parameter="brightness", value=20) img = apply_brightness(img, brightness) 步骤2:手动调整对比度 contrast = manual_adjust(parameter="contrast", value=15) img = apply_contrast(img, contrast) 步骤3:手动进行肤色校正 skin_params = manual_adjust_skin(tone="warm", intensity=10) img = adjust_skin_tone(img, skin_params) 步骤4:手动添加风格滤镜 filter_params = manual_select(filter="autumn", strength=70) img = apply_filter(img, filter_params) 需要大量手动操作,耗时30分钟以上 return img

上述代码的问题在于:每个参数都需要开发者手动指定数值,无法理解用户的自然语言意图,也无法根据图像内容自适应调整。

AI图片助手智能修图方式:

AI图片助手:自然语言驱动,自动理解与执行 from ai_image_assistant import ImageAssistant def ai_driven_image_editing(image_path, user_command): 初始化AI图片助手引擎 assistant = ImageAssistant() 步骤1:需求解析(将自然语言转化为结构化指令) 用户输入:"让这张风景照更有秋日氛围" command = "让这张风景照更有秋日氛围" operations = assistant.parse_command(command) operations = [ {"type": "color_adjust", "target": "foliage", "params": {"hue_shift": +15}}, {"type": "contrast_adjust", "target": "sky", "params": {"value": +20}} ] 步骤2:自动执行(底层调用AI模型完成操作) result = assistant.execute(image_path, operations) 步骤3:质量评估与自动优化 quality_score = assistant.assess_quality(result) if quality_score < 0.85: result = assistant.auto_enhance(result) 全过程自动化,用户只需输入一句话 return result

AI图片助手的核心优势在于:它建立了自然语言到图像操作的语义映射桥梁,用户无需理解HSL色彩模型、曲线调整等专业术语,只需用日常语言描述需求,系统就能自动解析并执行-7。同时,底层基于ComfyUI的节点式架构,支持需求解析、计划生成、操作执行三大模块的协同工作,将复杂流程拆解为可追溯、可调试的节点链路-7。

六、底层原理支撑

AI图片助手的技术实现离不开以下底层知识的支撑,它们是理解系统运作机制的关键基础:

1. 潜空间表示:AI无法直接在像素空间处理图像(512×512×3=78万维数据),因此采用变分自编码器将图像压缩到64×64×4的低维潜空间。AI的“思考”和“去噪”过程全部在这个压缩空间中进行,大幅降低了计算开销-。

2. 扩散与去噪机制:正向扩散向图像逐步添加噪声直至变成纯噪声,反向扩散则从纯噪声逐步预测并去除噪声、恢复出清晰图像。AI通过学习海量数据,掌握“什么样的像素组合是合理的”,从而在去噪过程中把不合理的噪声变为合理的图像内容-21。

3. 节点依赖解析与异步执行:ComfyUI内部通过execution.py实现异步执行引擎,配合graph.py完成节点依赖解析——系统会自动分析节点的输入输出关系,确定执行顺序,支持并行执行无依赖关系的节点,实现高效的任务调度-。

4. 需求解析引擎:AI图片助手的“语义理解”模块通常采用BERT+BiLSTM混合模型,在通用语料库基础上针对图像编辑领域进行微调训练,将自然语言指令转化为操作类型、目标区域、强度系数的结构化三元组序列-7。

这些底层技术构成了AI图片助手“理解需求 → 规划步骤 → 执行操作 → 质量评估”的完整闭环。

七、高频面试题与参考答案

Q1:ComfyUI和WebUI(如Stable Diffusion WebUI)的本质区别是什么?

参考答案:ComfyUI是基于节点式工作流的执行引擎,它将图像生成流程拆解为独立的功能节点,用户通过拖拽节点和连线来构建自定义工作流,支持精细控制每个环节。而WebUI采用固定流程,用户只能在有限的参数范围内调整。核心区别在于:ComfyUI是编排型(可定制流程),WebUI是配置型(只能调参数)。

Q2:VAE在AI图像生成中的作用是什么?为什么需要它?

参考答案:VAE(变分自编码器)包含编码器和解码器两部分。它的核心作用是将高清图像压缩到低维潜空间进行扩散处理,再解码还原。需要VAE的原因是:传统扩散模型直接在像素空间操作,计算量巨大(512×512×3),而VAE将图像压缩到64×64×4的潜空间,计算量降低约100倍,使得扩散模型可以在消费级GPU上运行。它回答的核心问题是:如何让AI高效处理高维图像数据。

Q3:CLIP是如何建立文本与图像之间语义关联的?

参考答案:CLIP(对比语言-图像预训练)通过对比学习的方式,将文本和图像映射到同一个向量空间。训练时,模型同时接收(文本,图像)配对数据,通过最大化配对样本之间的相似度、最小化非配对样本之间的相似度,学习到一个统一的语义表示空间。经过训练后,“狗”的文字向量和“狗”的图像向量在空间中位置接近,从而建立语义关联。面试踩分点包括:对比学习、共享向量空间、跨模态对齐。

Q4:ComfyUI工作流中的数据“分支”是如何实现的?

参考答案:ComfyUI中一个节点的输出端可以连接多个节点的输入端,数据会被复制并分发到各个分支节点。分支的典型应用场景包括:同一张图像同时输入到风格迁移节点和色彩调整节点,将两个处理结果在后续节点中融合。分支的实现依赖于节点的异步执行引擎——无依赖关系的分支节点可以并行执行,提升效率。核心要点:输出复制分发、并行执行、最终融合。

Q5:2026年AI图片助手的技术演进趋势是什么?

参考答案:2026年的AI图片助手呈现三大趋势:1)智能体化:从工具进化为智能体,如像素助手能够逐张分析照片并制定个性化修调方案,而非机械执行统一指令-5;2)生成编辑一体化:如Qwen-Image-2.0将生成与编辑能力原生集成,用户通过自然语言即可完成从生成到精修的全流程-;3)工作流自动化:如Krea AI的Node Agent能自动编排多步图像处理流程,比手动方法快50%-。

八、结尾总结

本文围绕AI图片助手这一核心主题,从传统图像编辑的痛点出发,系统梳理了ComfyUI的节点式工作流原理、Stable Diffusion四大核心组件(VAE、CLIP、Token、UNet)的功能定位,以及它们之间的逻辑关系。通过代码示例直观对比了手动修图与AI图片助手的差异,并深入到潜空间表示、扩散机制、节点依赖解析等底层原理,最后给出了5道高频面试题的规范答案。

核心要点回顾:

AI图片助手的本质是自然语言到图像操作的语义映射系统;

ComfyUI是编排框架,节点是功能单元,工作流是连接方案;

VAE负责压缩/解压图像,CLIP建立文本-图像语义桥梁,UNet负责预测噪声;

潜空间计算使扩散模型可在消费级GPU运行,效率提升约100倍。

对于开发者而言,理解AI图片助手的完整技术链路,不仅是面试备考的必备能力,更是在实际项目中实现高效图像处理的基石。下一篇将深入探讨AI图片助手的工程化部署与性能优化,敬请期待。