标题:2026年4月AI创作助手核心技术全解析——原理·代码·面试(28字)

引言

AI创作助手(AI Creative Writing Assistant)是指基于大语言模型(Large Language Model,LLM)等技术构建的智能工具,能够辅助甚至主导文本、代码、图像等多种形式的创意内容生成。2026年,这一领域已迎来爆发式增长——据市场研究机构预测,AI创作助手市场规模将从2025年的22亿美元增长至2026年的26.7亿美元,年复合增长率高达21.4%-。与此同时,87%的创意从业者已在日常工作中使用AI工具,其中66%达到每周高频使用水平-。

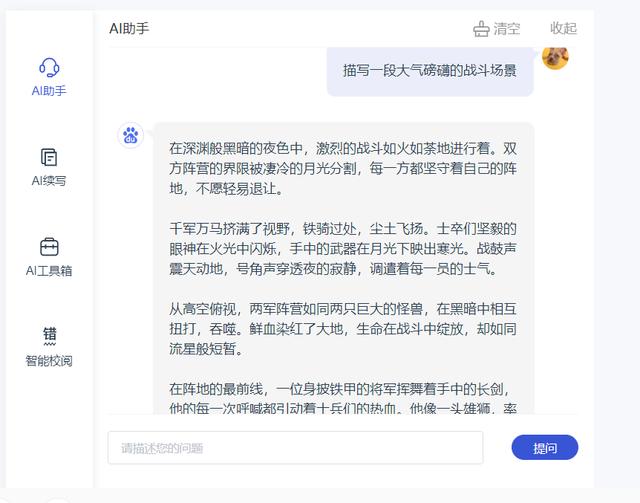

许多开发者在使用AI创作助手时,常常陷入 “只会调API,不懂底层原理;会用工具,却答不出面试题” 的困境。本文将从技术原理出发,系统拆解AI创作助手的核心概念与实现机制,搭配可运行的代码示例,提炼高频面试考点,帮助读者建立完整的技术认知链路。文章涵盖:为什么需要AI创作助手、LLM与RAG两大核心概念及其关系、简易代码实现、底层技术支撑,以及3~5道必考面试题与参考答案。

一、痛点切入:为什么需要AI创作助手?

在没有AI创作助手的时代,内容创作面临三大痛点。

旧有流程痛点:传统内容创作以纯人工方式为主——写一篇技术博客,作者需要先构思大纲,然后逐字撰写、反复修改,遇到专业知识盲区还需查阅大量文档。整个过程高度依赖个人经验,效率低下且难以复用。即使使用模板化工具,生成的也只是“填空式”内容,缺乏个性化和灵活性。

具体缺点:耦合高(创作思路与具体表达强绑定,修改一处可能牵动全局)、扩展性差(增加新的内容形式或风格需要大量重复工作)、维护困难(多人协作时风格难以统一,内容质量参差不齐)、代码冗余(在编程场景中,大量重复性的样板代码需要手动编写)。

AI创作助手的出现,正是为了解决这些问题。它能够根据用户输入的自然语言指令,自动生成符合要求的内容,将创作者从繁琐的执行层工作中解放出来,使其能够更专注于创意本身。

二、核心概念讲解:大语言模型(LLM)

标准定义:大语言模型(Large Language Model,LLM)是一种基于深度学习架构、在海量文本数据上训练而成的语言处理模型,能够理解并生成自然语言。

拆解关键词:

“大” :指模型参数量巨大,从数十亿到数万亿不等。参数是模型内部的可学习权重,决定了模型的知识储备和表达能力。

“语言” :指模型专门处理自然语言任务,包括理解、生成、翻译、总结等。

“模型” :指通过机器学习训练得到的数学函数,能够将输入映射到输出。

生活化类比:可以把LLM想象成一个 “读过整个图书馆所有书的学生” ——他从未真正“理解”书中的内容,但积累了海量的语言模式与知识关联。当你向他提问时,他不是在“思考”,而是基于过往的阅读经验,用统计概率推断出最有可能的下一句话。这就是为什么LLM有时候会“编造”事实(业内称为“幻觉”),因为它在预测概率,而非检索真相。

作用与价值:LLM是AI创作助手的“大脑”,负责理解用户意图并生成回复内容。它的出现使得机器具备了接近人类的语言交互能力,为各类创意应用提供了底层能力支撑-。

三、关联概念讲解:检索增强生成(RAG)

标准定义:检索增强生成(Retrieval-Augmented Generation,RAG)是一种将LLM与外部知识库相结合的技术框架,在生成回答前先从数据库中检索相关信息,然后将检索到的内容作为上下文输入给LLM-。

LLM与RAG的关系:LLM是核心生成引擎,RAG是“外挂知识库”。纯LLM只能依赖训练时学到的知识(存在时效性和覆盖范围限制),而RAG让LLM能够实时“查资料”,从而生成更准确、更新的答案。

对比差异:

| 维度 | 纯LLM | RAG增强型LLM |

|---|---|---|

| 知识来源 | 仅训练数据 | 训练数据 + 实时检索 |

| 时效性 | 取决于训练截止日期 | 可接入最新知识 |

| 准确性 | 可能产生“幻觉” | 引用外部事实,更可靠 |

| 计算成本 | 低 | 较高(需额外检索开销) |

简单运行机制示例:用户问“2026年AI创作助手市场规模是多少?” → RAG系统先从外部数据库检索到“26.7亿美元” → 将检索结果作为上下文与用户问题一同发送给LLM → LLM基于上下文生成准确回答-。

四、概念关系与区别总结

核心逻辑:LLM是“大脑” (负责理解和生成),RAG是“外挂资料库” (负责提供实时事实支撑)。二者是 “能力底座”与“能力增强” 的关系,而非互斥选择——在实际应用中,两者通常协同使用。

一句话概括:LLM解决了“怎么说”的问题,RAG解决了“说什么对”的问题。

对比记忆:可以把LLM想象成一位知识渊博但信息可能过时的专家,RAG则是他手中可以实时查阅的最新资料库——专家负责“表达”,资料库负责“确保事实准确”。

五、代码示例:极简AI创作助手实现

以下是一个使用Python调用OpenAI API的极简示例,演示如何实现一个基础的AI创作助手。

极简AI创作助手核心实现 import openai 配置API密钥 openai.api_key = "your-api-key" def ai_writing_assistant(prompt: str, context: str = None) -> str: """ AI创作助手核心函数 :param prompt: 用户输入的创作需求 :param context: 可选的上下文信息(如示例风格、前文内容等) :return: AI生成的内容 """ 步骤1:构造消息列表 messages = [{"role": "system", "content": "你是一位专业的AI创作助手,擅长各类文本生成任务。"}] 步骤2:如有上下文,追加至用户消息 full_prompt = f"{context}\n\n{prompt}" if context else prompt messages.append({"role": "user", "content": full_prompt}) 步骤3:调用LLM生成内容 response = openai.ChatCompletion.create( model="gpt-4", messages=messages, temperature=0.7, 控制创造性,范围0-2,值越高越随机 max_tokens=1000 ) 步骤4:返回生成结果 return response.choices[0].message.content 使用示例 prompt = "写一篇关于AI创作助手的简短介绍,面向技术开发者。" result = ai_writing_assistant(prompt) print(result) 带上下文的示例:要求模仿特定风格 prompt = "写一篇AI创作助手的技术博客开篇" context = "请模仿我之前的写作风格:语言通俗、条理清晰、适当使用类比。" result_with_context = ai_writing_assistant(prompt, context) print(result_with_context)

执行流程解释:

消息构造:将系统指令(设定AI角色)和用户输入(创作需求)组织成LLM可理解的消息格式。

API调用:发送请求至LLM服务端,

temperature参数控制生成结果的随机程度——值越低结果越确定,值越高越富有创造性。结果解析:从返回的响应对象中提取生成的文本内容。

六、底层原理与核心技术支撑

AI创作助手的底层能力,依赖三大核心技术支柱:

1. Transformer架构:这是所有现代LLM的基石。与传统循环神经网络(RNN)逐词串行处理不同,Transformer通过自注意力机制(Self-Attention) 并行计算输入序列中所有元素之间的关联权重,能够高效捕捉长距离依赖关系-。通俗理解:RNN像一个人逐字阅读,读完后面可能忘了前面;Transformer像一眼扫过整页,能同时看到所有词语之间的关系。

2. 预训练+微调范式:模型先在海量通用数据上进行预训练(学习语言的基本规律),然后在特定领域数据上进行微调(适应具体任务)。这种范式使得AI创作助手既能具备广泛的语言能力,又能针对创作场景优化表现-。

3. Agent智能体架构:2026年,AI创作助手正在从“对话式辅助工具”演进为具备自主规划与工具调用能力的 “智能体(Agent)” -。现代AI创作助手不再仅仅是“回答问题”,而是能够主动拆解任务、调用外部工具(如引擎、数据库、代码解释器)、多步骤协同完成复杂创作目标。

2026年的前沿AI创作助手还开始采用 “混合专家模型(Mixture of Experts, MoE)” 技术,将模型参数拆分为多个专业“专家模块”,不同模块分别负责逻辑推理、语言润色、事实核查等任务,动态调用对应模块,既提升了响应速度,又保证了内容的逻辑性与准确性-。

七、高频面试题与参考答案

面试题1:请解释LLM中的“幻觉”现象,并说明如何缓解。

参考答案:

定义:LLM的“幻觉”指模型生成看似合理但实际不真实或无根据的内容。本质原因是LLM是基于概率预测的生成模型,而非事实检索系统——它“知道”的是词语之间的统计关系,而非客观真理。

缓解方法:(1)采用RAG技术引入外部知识库检索,让模型基于事实生成;(2)使用提示工程(Prompt Engineering),要求模型标注不确定的部分;(3)在关键场景接入事实核查工具进行验证。

踩分点:点明根源(概率生成 vs 事实检索)→ 列出2~3个具体缓解方案 → 说明各方案适用场景。

面试题2:RAG与Fine-tuning(微调)有什么区别?分别适用于什么场景?

参考答案:

RAG:在推理时从外部知识库检索相关信息,附加到提示中增强模型回答。优点:知识可实时更新、无需重新训练、适合开放域问答。Fine-tuning:在预训练模型基础上,用特定领域数据继续训练,调整模型参数。优点:可改变模型行为风格、适合特定任务优化。

选型建议:需要接入实时/动态知识选RAG;需要改变模型输出风格或格式选Fine-tuning;两者结合效果最佳。

踩分点:区分“推理时增强”与“训练时调整” → 对比优缺点 → 给出选型判断依据。

面试题3:Transformer中的自注意力机制是如何工作的?

参考答案:

自注意力机制的核心思想是:对于输入序列中的每个词,计算它与序列中所有其他词的“关联强度”(注意力权重),然后根据这些权重加权聚合信息。具体通过三个矩阵实现:Query(查询)、Key(键)、Value(值)。每个词生成自己的Query,与所有词的Key计算相似度得到注意力权重,再用权重对Value加权求和,得到该词的“注意力感知表示”。这使得模型能够动态聚焦于输入中的关键信息,而非固定位置。

踩分点:解释Q/K/V的角色 → 说明注意力权重的计算逻辑 → 指出其并行计算与长距离捕捉优势。

八、结尾总结

核心知识点回顾:

AI创作助手:基于LLM的智能创作工具,2026年市场规模预计达26.7亿美元,87%创意从业者已投入使用--。

LLM:AI创作助手的“大脑”,基于Transformer架构的概率语言模型。

RAG:为LLM“外挂”知识库,解决事实准确性问题。

底层技术:Transformer + 自注意力机制 + 预训练微调范式 + Agent智能体架构。

重点强调:理解AI创作助手的核心在于把握 “LLM是底座,RAG是增强,Agent是方向” 这一递进逻辑。

预告进阶内容:下一篇将深入探讨如何从零构建一个可商用的AI创作助手系统,涵盖多模型路由、缓存策略、成本优化等实战主题。